Der Gesprächspartner muss auf jede unserer Fragen antworten. Anschließend bekommt er seine Antworten vorgelegt und kann sie autorisieren.

Zum journalistischen Leitbild von t-online.Gefahren im Internet "All das kann sich morgen ändern"

Das Internet ist laut IT-Experte Mikko Hyppönen so gut und sicher wie nie. Doch eine Technologie könnte uns bald angreifbarer machen als je zuvor.

Ein Cyberangriff hat kürzlich mehrere Londoner Kliniken lahmgelegt. Auch die CDU wurde Anfang Juni attackiert, ebenso wie die Plattform Ticketmaster, von der 560 Millionen Nutzerdaten gestohlen und im Netz verbreitet wurden. In der öffentlichen Wahrnehmung nehmen solche Fälle täglich zu.

Und doch sagt der finnische IT-Sicherheitsexperte Mikko Hyppönen, die Cybersicherheit unserer Systeme und Geräte befinde sich in einem besseren Zustand als je zuvor. Was er damit meint und worum sich die Öffentlichkeit stattdessen sorgen muss, erklärt er im Interview.

t-online: Herr Hyppönen, warum unterscheidet sich die gefühlte Sicherheit so sehr von der Realität?

Mikko Hyppönen: Denken Sie einmal zehn Jahre zurück: Da wurde unser Computer mit Schadcode – einem Virus oder Trojaner – infiziert, weil wir auf einen falschen Link geklickt haben. Mittlerweile müssen wir uns um ganze Kategorien von Sicherheitslücken von damals keine Sorgen mehr machen. Mobile Betriebssysteme wie iOS und Android sind aus meiner Sicht die größte Sicherheitsverbesserung der letzten 15 Jahre. Das ist ein Unterschied wie Tag und Nacht.

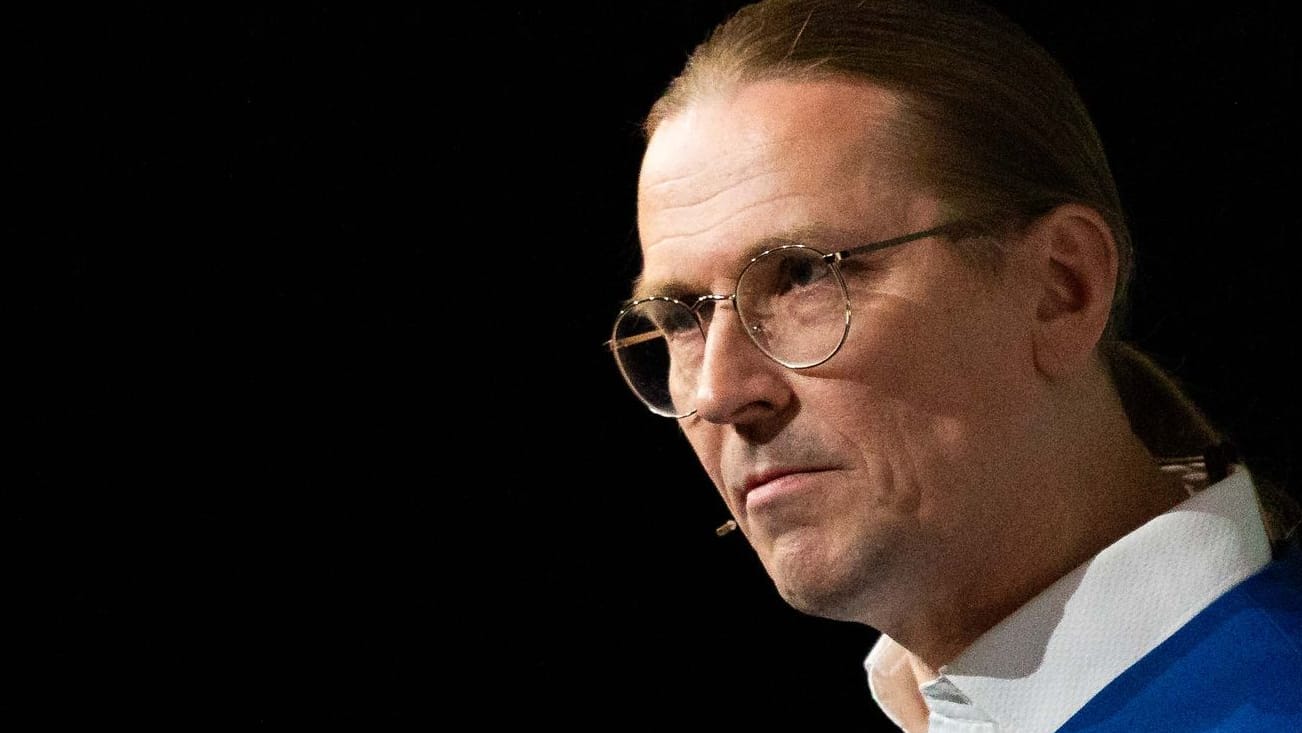

Zur Person

Mikko Hyppönen ist Leiter der Forschungsabteilung beim finnischen Sicherheitsanbieter WithSecure und ein weltweit anerkannter Experte für IT-Sicherheit. Er hat Hintergrundberichte und Forschungsergebnisse in der New York Times, Wired und Scientific American veröffentlicht und lehrte an den Universitäten Oxford, Stanford und Cambridge. Im Oktober 2021 veröffentlichte er sein erstes Buch "Was vernetzt ist, ist angreifbar: Wie Geheimdienste und Kriminelle uns im Netz infiltrieren".

Als Nutzer bin ich trotzdem machtlos, wenn ein Unternehmen gehackt wird und meine Daten gestohlen werden. Wie kann man sich davor schützen?

Gar nicht. Aber es wird besser – Stichwort: Datenschutzgrundverordnung (DSGVO). Ich bin kein Freund von Regulierung, aber vor der DSGVO mussten Unternehmen Ihnen nicht mitteilen, wenn Ihre Kreditkartendaten gestohlen wurden. Und das haben sie natürlich auch nicht. Heute sind sie durch das Gesetz verpflichtet, betroffene Nutzer über ein Datenleck zu informieren – ansonsten gibt es empfindliche Strafen. Insofern gibt es nicht plötzlich mehr Cyberattacken als vorher, wir erfahren einfach nur davon.

Wird Künstliche Intelligenz (KI) das Risiko, von Schadsoftware attackiert zu werden, nun noch erhöhen?

Da sehe ich zwei mögliche Szenarien: Zum einen sehen wir vereinzelt schon Schadcodes, die sich dank KI mit jeder Vervielfältigung leicht verändern – das macht es schwer, sie zu entdecken. Die meisten dieser Codes wurden aber mithilfe von ChatGPT geschrieben – und das ist ein geschlossenes System. Man benötigt die Genehmigung vom Hersteller OpenAI, um die Programmierschnittstelle – sogenannte APIs (Application Programming Interface) – nutzen zu können. Zudem kann OpenAI auch Nutzer blockieren, die diesen Code für Schadsoftware missbrauchen – also Viren, Trojaner oder Ähnliches programmieren. Langfristig kann OpenAI außerdem auch schon im Vorfeld bestimmte Ansätze blockieren, wenn sie verdächtige Fragen oder Befehle entdecken. Insofern kann die KI uns auch dabei helfen, Schadcodes zu erkennen.

Und das zweite Szenario?

Das ist die Automatisierung von Malware-Kampagnen, also der gesamte Prozess von der Entwicklung bis zur Durchführung von Angriffen, die Verbreitung und all das. Das kann schon morgen beginnen und dann haben wir ein Problem. Im Moment arbeiten die Angreifer zum Glück noch sehr langsam, noch wird alles von Hand gemacht. Dadurch haben wir einen Vorteil. Denn wir – also die "Guten" – haben schon vor Jahren damit begonnen, unsere Abläufe zu automatisieren. Wir haben fast 100.000 Köder im Internet ausgelegt, die nur darauf warten, infiziert zu werden. Dadurch sammeln wir Daten, die wir von einer KI auswerten lassen und die uns dabei hilft, diese Risiken besser zu erkennen und innerhalb von wenigen Minuten Gegenmaßnahmen einzuleiten. Aber wie gesagt, die Bösen holen auf.

Dann kämpft gute KI gegen böse KI?

Ganz genau. Und dann wird sich zeigen, wer am Ende gewinnt. Ich kann es nicht sagen. Ich hoffe natürlich, dass wir gewinnen, weil wir viele Jahre Vorsprung haben. Bei WithSecure (damals F-Secure, Anm. d. Red.) haben wir 2005 damit angefangen, Prozesse zu automatisieren – das ist 19 Jahre her. Ich glaube zwar, dass wir besser sind, aber ich könnte auch Unrecht haben. Wir werden es bald erfahren.

Wie bald?

In den nächsten sechs Monaten.

Was wird passieren, wenn die "Bösen" gewinnen?

Wenn die Bösen hier gewinnen, haben sie dauerhaft die Oberhand. Wir als Sicherheitsunternehmen könnten die Nutzer nicht mehr wirksam vor neuen Angriffen schützen. Angreifer könnten schneller auf unsere Abwehrmaßnahmen reagieren, als wir sie einsetzen könnten. Die dunkle Seite würde gewinnen.

Können Regularien wie der AI Act der Europäischen Union etwas gegen die drohenden Gefahren von KI ausrichten?

Der AI Act hat leider einen falschen Ansatz. Er versucht, sämtliche Fragen rund um KI mit einem Dokument zu beantworten: die Auslöschung der Menschheit durch die Superintelligenz, Cybersicherheit, Urheberrechte und noch vieles mehr. Das kann nicht funktionieren.

Es kann dann vermutlich auch nichts gegen die Gefahr einer Verselbstständigung der KI ausrichten, also einer Superintelligenz?

Genau. Es ist zwar umstritten, ob es die überhaupt geben wird, aber ich kann mir gut vorstellen, dass wir irgendwann eine Superintelligenz erschaffen werden. KI und Computer sind auch heute schon so viel besser als wir Menschen in vielen Bereichen. Sie können besser rechnen, Schach spielen, selbst in der Literatur und Kunst sind sie zum Teil besser.

Gerade diese kreativen Bereiche werden ja gerne als besonders "menschlich" bezeichnet.

Stimmt. Aber bitten Sie doch die KI-Programme Suno oder Udio mal, einen Ohrwurm zu generieren. Dann bekommen Sie einen Ohrwurm. Ich habe das ausprobiert. Drei Wochen später habe ich das von der KI komponierte Lied plötzlich im Auto vor mich hingesummt. Das Programm weiß ganz genau, was wir Menschen uns einprägen. Das ist total beeindruckend – und gleichzeitig hasse ich es. Wir dachten immer, Kunst wäre besonders menschlich. Und jetzt merken wir, dass es das nicht ist. Und die Entwicklung fängt gerade erst an.

Sie warnen seit Jahren davor, dass auch die Zunahme von smarten Geräten – vor allem im Haushalt – ein Problem für unsere Sicherheit sei. Ist es wirklich nötig, dass elektrische Geräte wie der Kühlschrank und die Waschmaschine mit dem Internet verbunden sind?

Nein, nötig ist das nicht – aber es wird so kommen. Das ist die Zukunft, egal, was ich davon halte. Aus Sicht der Hersteller ist das auch sinnvoll, denn die Geräte sind Informationsquellen. Und Daten bringen Geld, egal welcher Art. Ein Beispiel aus meinem Buch sind Küchenmixer: Sollen wir im Osten von München mehr Werbung schalten als im westlichen Teil, weil es dort weniger Kunden gibt? Wenn Hersteller die Möglichkeit haben, diese Daten zu sammeln, werden sie sie auch nutzen.

Unabhängig davon, dass alle elektrischen Geräte potenziell auch riesige Datenkranken sind, warum sind sie so anfällig für Schadware?

Weil die meisten Hersteller dieser Geräte und auch die meisten Kunden sich keine Gedanken über Sicherheit machen. Das wichtigste Kaufkriterium ist der Preis, das günstigste Produkt gewinnt. Wenn die Hersteller Wert legen auf die Entwicklung der Sicherheit für Küchengeräte, dann kostet das Geld und das Produkt wird teurer. Ich bin kein Freund von Vorschriften, aber für solche smarten Geräte im Haushalt wäre eine Regulierung durchaus sinnvoll.

Was sind Deepfakes?

Deepfakes sind manipulierte Videos oder Audioaufnahmen, die mithilfe Künstlicher Intelligenz so verändert wurden, dass Personen Dinge sagen oder tun, die sie in Wirklichkeit nie gesagt oder getan haben. Diese Fälschungen können täuschend echt aussehen und werden oft eingesetzt, um Desinformationen zu verbreiten oder Personen zu schaden.

Sie haben einmal gesagt, die sicherste Abwehr ist ein informierter Nutzer. In welchen Bereichen des Alltags sollten Nutzer besser sensibilisiert werden?

Da würde ich den Bereich Informationsverarbeitung und sogenannte Deepfakes und Wahlbeeinflussung nennen. In diesen Fällen machen aufmerksame Nutzer und informierte Wähler den entscheidenden Unterschied aus. 2016 wurde Donald Trump Präsident der USA, 2017 folgte der Brexit – beides aufgrund von Wahlbeeinflussungsmaßnahmen. Heute würde das zum Glück nicht mehr so gut funktionieren, damals hatten die Leute noch keine Ahnung von dieser Form der Manipulation.

Aber auch heute warnen Behörden vor "Angriffen auf die Demokratie" – gerade in diesem Superwahljahr. Glauben Sie wirklich, dass Wahlbeeinflussung kein Problem mehr ist?

Doch, es ist immer noch ein Problem – aber es wird besser. Vor 1993 war es extrem schwierig, ein Foto so zu fälschen, dass es nicht zu erkennen war – das haben höchstens Regierungen gemacht. Dann kam Photoshop und plötzlich konnte jeder ohne Probleme oder großen Aufwand ein Bild fälschen. Und dadurch hat sich unsere Sicht auf Bilder verändert, wir haben das, was wir sehen, mehr infrage gestellt. Und genau das wird mit Tonaufnahmen und Videos passieren. Wir werden sie mehr und mehr hinterfragen. Es wird weit davon entfernt sein, dass jeder von uns sämtliche Manipulationen sofort erkennt – aber umso wichtiger sind Bildung und Aufklärung.

Wie groß ist die Gefahr, dass jemand mit gefälschten Fotos oder Videos von mir, den sogenannten Deepfakes, an meine persönlichen Daten kommt?

Die Gefahr der Manipulation durch Deepfakes von einzelnen Personen besteht heutzutage noch gar nicht – zumindest nicht im großen Stil. Ich habe schon Videogespräche mit Leuten geführt, die mein Gesicht geklont und benutzt haben – das sah sehr überzeugend aus. Die Technologie ist da, aber sie wird in dieser Form nicht genutzt. Noch nicht. Aber warum auch? Nehmen wir zum Beispiel den berühmten Enkeltrick: Ein weinender Teenager ruft eine ältere Frau an und sagt: 'Oma, weißt du, wer hier ist?' Leider fallen noch immer zu viele Leute darauf herein – und da helfen auch keine neuen Technologien. Gegen so etwas hilft nur Aufklärung.

Vielen Dank für das Gespräch!

- Interview mit Mikko Hyppönen